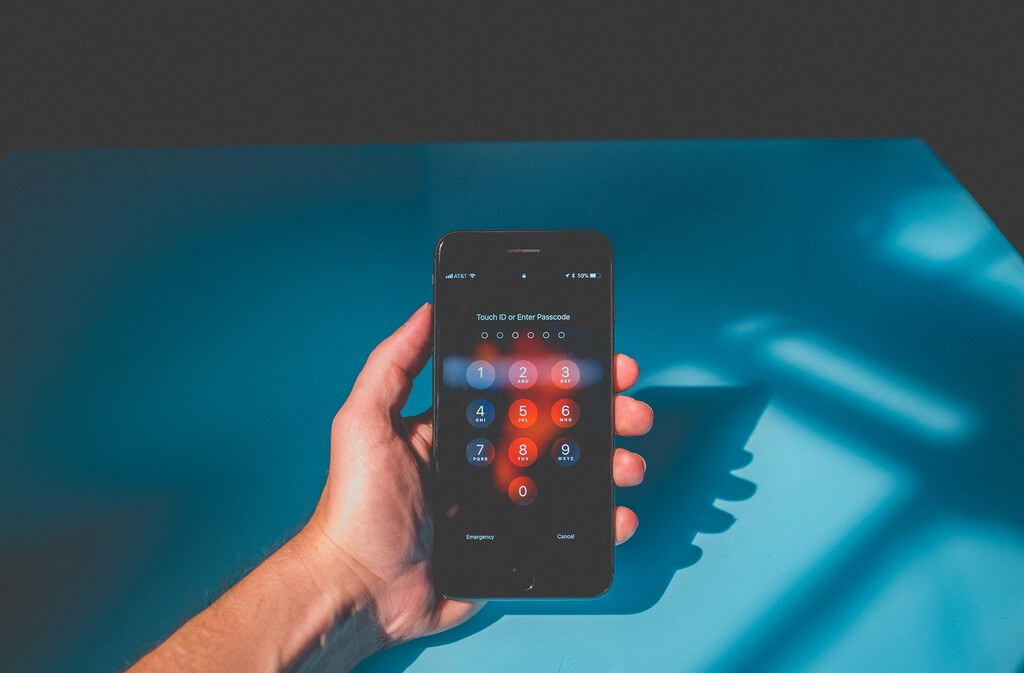

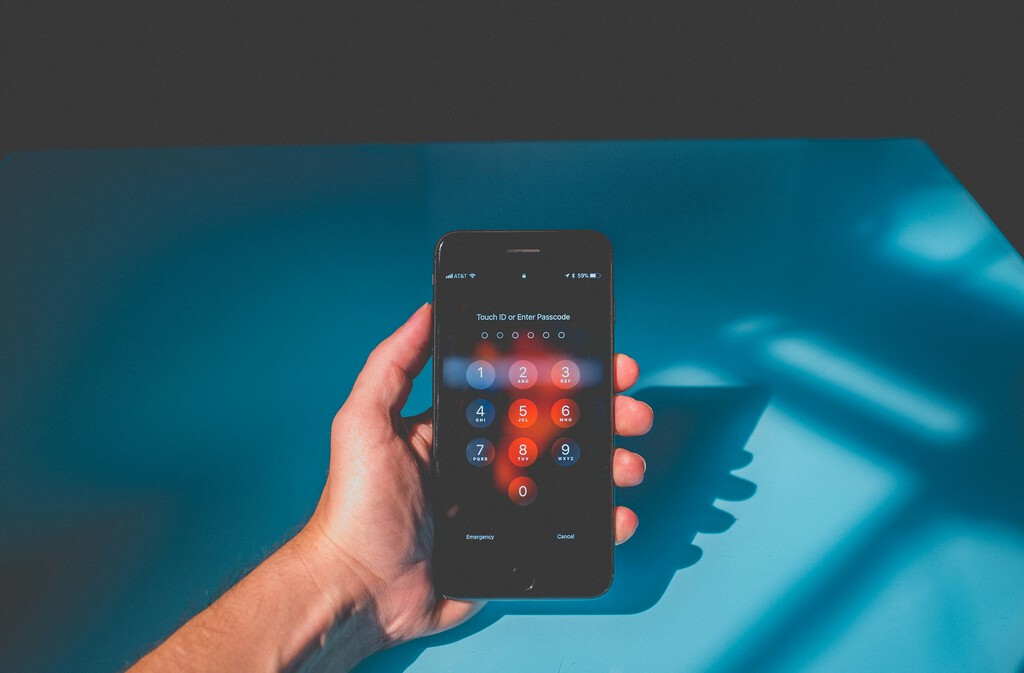

Não é proteção, é uma armadilha: o erro fatal de confiar em inteligências artificiais para criar as suas senhas

Pedir a uma IA que crie uma “senha forte” pode parecer inteligente — mas pode ser exatamente o contrário. Um estudo de uma empresa de segurança chamada Irregular mostrou que senhas geradas por modelos como OpenAI (ChatGPT), Anthropic (Claude) e Google (Gemini) são surpreendentemente previsíveis.

Apesar de parecerem complexas, muitas repetem padrões. Em um teste, dezenas de senhas tinham estruturas quase idênticas, começando com as mesmas letras e números. Houve até repetições exatas. O problema é estrutural: modelos de linguagem são treinados para gerar padrões plausíveis — não aleatoriedade real.

E segurança depende justamente do oposto: imprevisibilidade. Uma senha forte precisa de alta entropia, ou seja, verdadeira aleatoriedade. Quando há padrões previsíveis, a dificuldade para quebrá-la cai drasticamente.

Especialistas alertam que não adianta “pedir melhor” para a IA ou ajustar comandos. O próprio funcionamento desses sistemas favorece sequências estatisticamente prováveis.

Usar IA para criar senhas pode dar uma falsa sensação de proteção. Para segurança real, o ideal continua sendo um gerador criptograficamente seguro ou um gerenciador de senhas confiável.

–

A notícia

Não é proteção, é uma armadilha: o erro fatal de confiar em inteligências artificiais para criar as suas senhas

foi publicada originalmente

Xataka Brasil

por

Vika Rosa

.